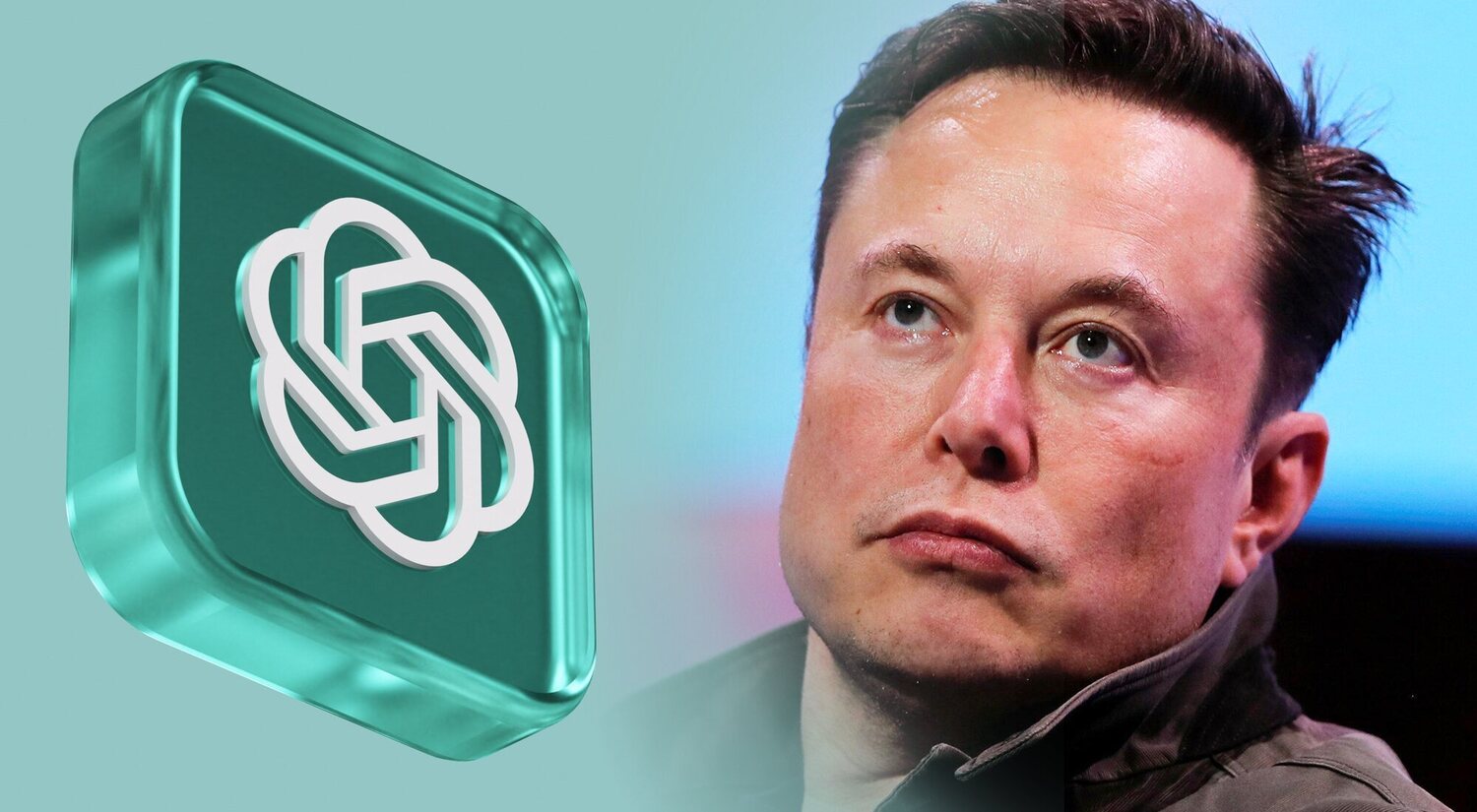

Elon Musk y expertos piden frenar el desarrollo de IA por suponer "un riesgo para la sociedad y la humanidad"

Una carta abierta llamada 'Pausar experimentos gigantes de IA' recoge todas las propuestas que Elon Musk y numerosas personalidades influyentes del sector han firmado para dar tiempo a los gobiernos a legislar sobre sus peligros.

| 03 Abril 2023

El vertiginoso avance de los sistemas de inteligencia artificial generativa se está convirtiendo en una gigantesca causa de preocupación global. Llevamos meses leyendo sobre los efectos que pueden llegar a tener sobre la sociedad tal y como la conocemos cuando empiecen a desarrollar todo su potencial. Y es que la amenaza de una nueva revolución industrial sobrevuela nuestras cabezas dispuesta a instaurarse de la manera más agresiva posible en nuestras vidas.

O eso, al menos, es lo que sostienen cientos de expertos que han pedido parar la peligrosa carrera de la inteligencia artificial durante, al menos, seis meses para que a los gobiernos les dé tiempo a legislar sobre ella. Entre los firmantes se encuentran Elon Musk, Steve Wozniak, numerosas personalidades, académicos, empresarios, investigadores...

— Elon Musk (@elonmusk) March 19, 2023

Las preocupaciones de Elon Musk y compañía

Los firmantes de esta propuesta han redactado una carta abierta llamada 'Pausar experimentos gigantes de IA' en la que han expuesto sus preocupaciones. Esta está dirigida a "todos los laboratorios de IA" para que cesen el entrenamiento de los sistemas más potentes que GPT-4 durante medio año, porque estos pueden plantear "grandes riesgos para la sociedad y la humanidad", algo que hasta el propio CEO de OpenAI (compañía desarrolladora de ChatGPT) reconoció hace unas semanas en una entrevista con ABC News con un sonado "esto me asusta un poco".

Volviendo al comunicado, en él se exige que la moratoria planteada sea pública, verificable y que incluya a todos actores clave para que ningún agente se vea beneficiado del cese de las actividades de la competencia y para que no se consigan nuevos avances. Pero no solo eso, también piden a los gobiernos que intervengan si la pausa no se ejecuta con rapidez. El ejemplo de cómo estos pueden actuar lo hemos visto en Italia, donde el gobierno ha bloqueado el acceso a ChatGPT. Eso sí, no ha sido por las preocupaciones explicadas en la carta abierta, sino por incumplir la normativa de protección de datos. Aun así, no deja de ser el primer escollo que se le plantea a la nueva tecnología que demuestra que es posible enfrentarse a ella desde el marco jurídico.

Lo más visto

Según los firmantes, los laboratorios no están cumpliendo con los 23 principios Asilomar en IA que se establecieron en 2017 para un correcto desarrollo de estas tecnologías, ya que no se está planificando y administrando con el cuidado y recursos correspondientes porque las distintas compañías han entrado en una carrera fuera de control para conseguir la inteligencia artificial más poderosa, lo que ha acabado por conseguir que ni los creadores sepan predecir, entender y controlar de forma fiable su producto.

Todo ello da pie a las clásicas preguntas que llevan inundando las mentes sobre la sustitución de los humanos por robots que tantas películas de ciencia ficción han explorado, pero esta vez con la nueva tecnología: "¿Deberíamos automatizar todos los trabajos? ¿Deberíamos desarrollar mentes no humanas que eventualmente podrían superarnos en número, ser más inteligentes, obsoletas y reemplazarnos? ¿Deberíamos arriesgarnos a perder el control de nuestra civilización? ¿Deberíamos dejar que las máquinas inunden nuestros canales de información con propaganda y falsedad?". La carta asegura que las respuestas a esas preguntas no deben salir de las mentes de un puñado de líderes tecnológicos que nadie ha elegido, y que los sistemas más potentes de IA solo deberían desarrollarse cuando exista una seguridad de que sus efectos serán positivos y sus riesgos manejables.

No obstante, los firmantes de la carta no piden que las compañías y sus programadores se alejen de su creación durante esos meses, sino que enfoquen sus esfuerzos de diferente forma. Sostienen que durante el cese de los esfuerzos por ganar una carrera peligrosa, "la investigación y el desarrollo de IA deben reenfocarse en hacer que los sistemas potentes y de última generación sean más precisos, seguros, interpretables, transparentes, robustos, alineados, confiables y leales".

También solicitan a los desarrolladores que trabajen junto a los gobiernos para legislar en torno a la IA para crear autoridades reguladoras nuevas, supervisar a los sistemas de alta capacidad, instaurar marcas de agua rastreables que hagan posible la detección de las imágenes generadas por inteligencias artificiales, conseguir financiación para la seguridad...

¿Y si los empresarios firman porque no tienen asegurado parte del pastel?

La carta es bastante incendiaria, y la reacción no se ha hecho esperar. Hay quien piensa que otro gallo cantaría si en lugar de OpenAI fueran las empresas de algunos de los firmantes las que estuvieran liderando este incipiente campo. Otros, centrándose en las peticiones, no tienen claro cómo se podría asegurar que las compañías no dirían públicamente que no se está trabajando en nada, pero clandestinamente estarían continuando con el desarrollo de las IA. Es complicado saber hasta qué punto estas personas están preocupadas por el futuro de la civilización o por el de sus bolsillos.

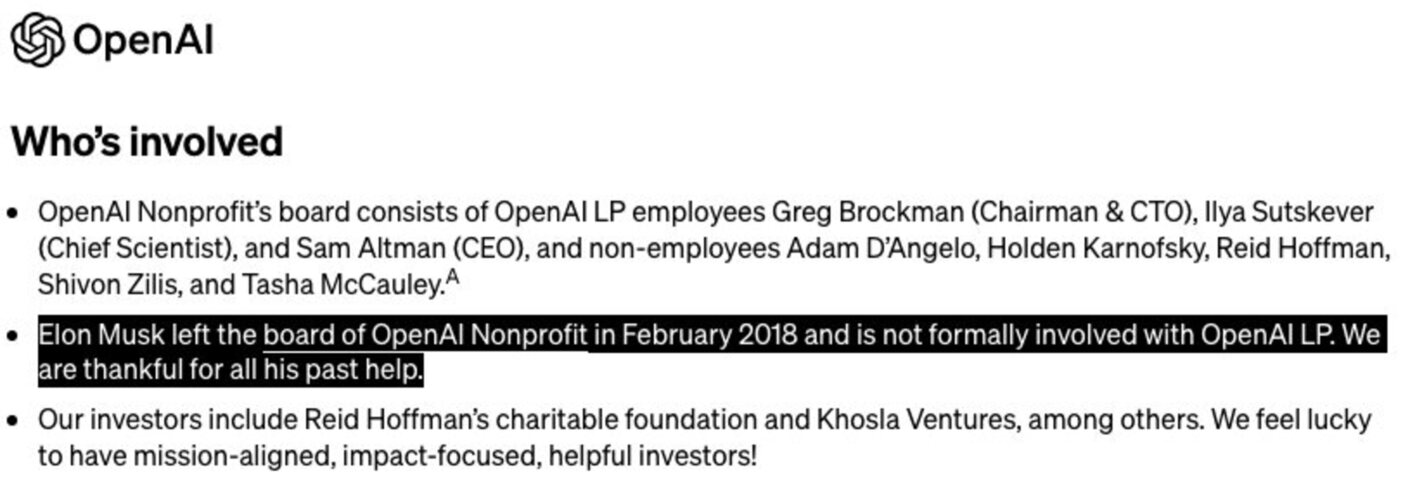

La línea se difumina incluso más en el caso de Elon Musk, ya que realmente no se sabe si tiene alguna participación en OpenAI actualmente. Y es que el sudafricano cofundó esta compañía en 2015 donando 100 millones de dólares, pero renunció a su cargo de copresidente en 2018. Además, él mismo ha dicho en su Twitter que no tiene ni propiedad ni control, pero quién sabe si tiene alguna participación.

Sea como sea, las preocupaciones por el futuro incierto que nos van a dejar este tipo de inteligencias artificiales son totalmente fundadas. Da verdadero miedo pensar en cómo puede llegar a afectar nuestras vidas cuando haya desarrollado gran parte de su potencial, en caso de que los expertos tengan razón: los millones de puestos de trabajo que puede fulminar, lo difícil que va a ser discernir entre realidad y ficción... Es probable que no sea tan mala idea frenar el ritmo durante seis meses, aunque no parece que esto sea suficiente.